並於報告中提出「AI安全三角」(AI Security Triangle)的概念。在AI Chatbot 時代,相關討論多聚焦於大型語言模型(LLM)本身的風險,例如偏見與幻覺等問題,治理重心主要置於「軟體/模型」層面。然而,隨著發展邁入AI Agent時代,AI的價值與潛在風險將更直接體現在實際部署與執行場景中,亦即涉及軟硬體整合、跨系統協作以及與真實世界互動的行動能力。因此,AI Agent時代的安全治理,必須同步關注軟體與硬體兩端的風險控管與整體競爭力。

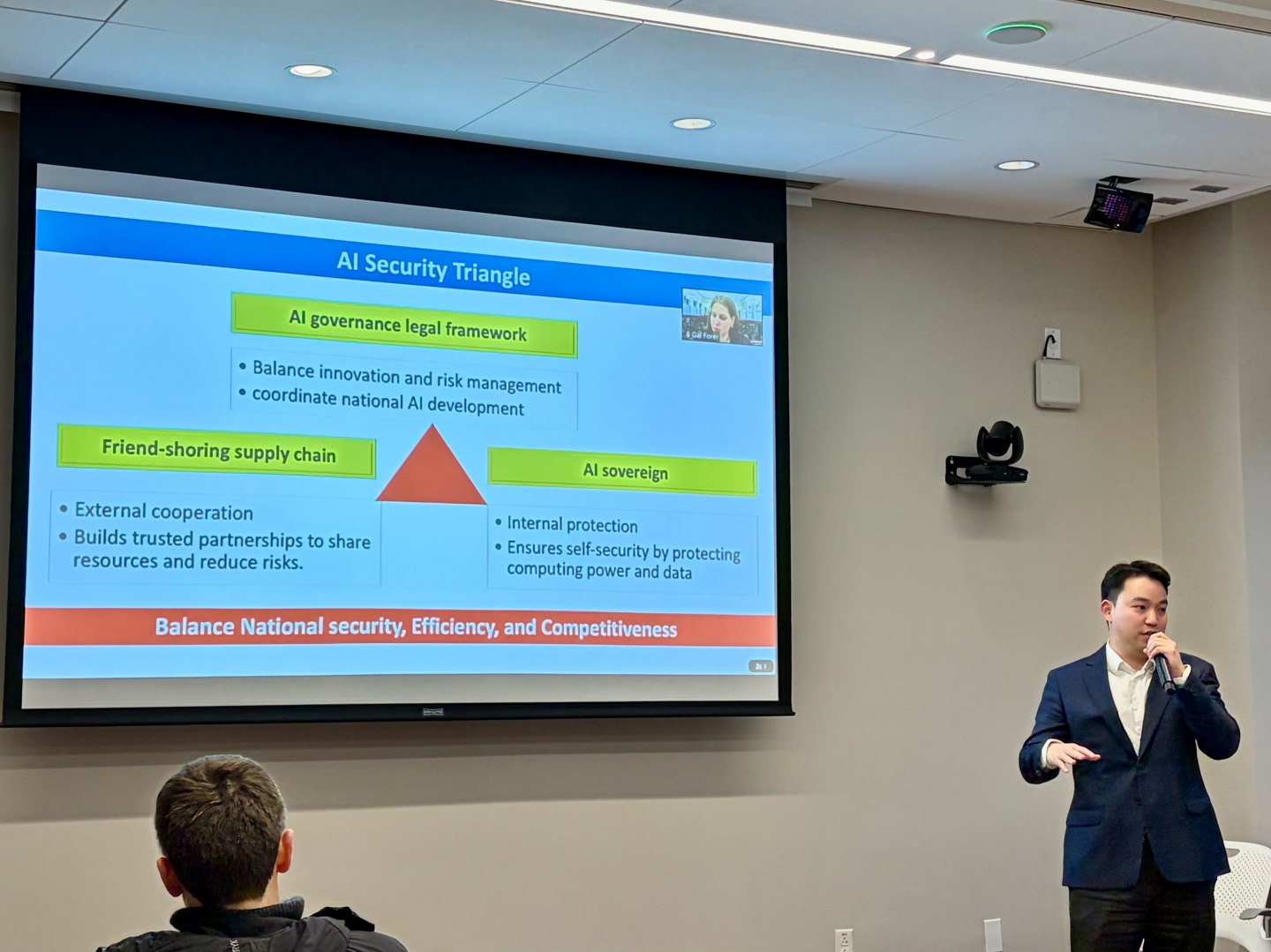

秘書長朱宸佐提出的「AI安全三角」包含三大支柱:

1.AI法律框架(安全核心):如何在風險控管與創新發展之間取得平衡,並清楚指引國家未來 AI發展方向與治理邊界。

2.友岸供應鏈(對外安全):在全球逐漸走向「一個世界、兩套系統」(one world, two systems)的格局下,如何建立可信任的友盟供應鏈,維持關鍵技術與供應的安全與穩定;華府簽署的《矽和平宣言》(Pax Silicon)即是一個具代表性的案例。

3.AI主權(對內安全):建立自主的AI基礎設施、資料治理、語言模型與商業發展模式,以確保國家安全、資料主權與產業競爭力。

此外,值得關注的是台灣近期通過的《人工智慧基本法》,在全球 AI 監管版圖中開出一條新路!不同於歐盟、日本及美國加州以罰則為核心的硬法(Hard Law)監管模式,台灣採取原則導向的框架性立法,現階段不設罰則,屬於軟法(Soft Law)路徑,並更強調創新空間與社會參與。

當台灣的半導體與硬體供應鏈深刻影響全球之際,這套制度設計也釋放出一個強烈訊號:信任。台灣對全球供應鏈的影響力,不只來自產業實力,也根植於堅實且可預期的法律基礎。依《基本法》第18條,各部會將在法案施行後兩年內完成既有法規的盤點與完善,以落實《基本法》精神,並逐步形塑更完整的台灣AI法制體系。

台灣正在前進,世界也正在看!

採用全球最先進SSL 256bit傳輸加密機制

採用全球最先進SSL 256bit傳輸加密機制